AI辅助编程盗用开源软件代码,谁来担责。

AI辅助编程工具“洗代码”、“复制他人代码”是AI热潮下软件行业非常关注的问题,类似2022年Copilot被指抄袭开源软件的风波,在知乎等平台一直热度不减。

有很多大咖从技术角度进行了深入的探讨,认为AI辅助编程抄袭代码的可能性是存在的。源小印则通过本文从“责任承担”的角度,探讨这种纠纷应由谁承担责任。

Part 1 权利归属问题

与AI绘图的著作权归属问题的争议不同,AI辅助编程参与创作的软件,其著作权应当属于使用软件的人,这点基本没有争议。

由于软件作品需要实现具体的功能,相对静态的图片来说更为复杂,在实际开发过程中,并不是由AI辅助编程工具根据使用者输入的命令、参数等,直接生成整个软件作品。使用者一般是通过工具输出一些具体的方法、效果的代码,经过测试确认与自己的需求一致之后,编入已有的代码、文件中,呈现为一个整体的软件作品。由此可见,使用AI辅助编程工具的人才是创作人,也就是软件作者,享有软件的全部权利。

Part 2 责任承担问题

源小印认为一旦出现AI辅助编程工具盗用了他人代码的情况,应当由新软件作者承担责任。

前文已述,开发人员使用AI辅助编程工具创作了新软件A,则开发人员是软件A的作者(权利人),由此产生的纠纷均应由软件A的作者承担责任。此处争议点在于,由于“盗用代码”是工具自发的、黑盒的,软件A的作者既没有下达侵权的指令,对于侵权的过程与结果也是不知情的,由他承担责任是否合适。

根据(2021)最高法知民终51号判决等文书的观点,软件A的作者行使权利与对他人承担责任是两个不同的法律关系。一方便,法院一般不会因为软件A中包含涉及侵权的代码,就否定软件A的著作权,软件A的权利受到法律保护。另一方面,一旦其它作者因为软件A盗用自己的代码起诉其作者,该作者也应当承担责任,二者不可混为一谈。软件A作者知情与否、侵权恶劣程度、软件A的传播情况等,仅是考量责任情节的因素,不是侵权成立与否的条件。

Part 3 平台责任问题

软件A的作者遇到这种情况都会觉得很憋屈,“明明不是自己的过错,却要承担责任”。理论上,软件A的作者承担责任之后可以向AI辅助编程工具一方(下称:平台方)主张权利,要求平台方承担责任。实际操作过程中,平台方在发布工具之时,就已经通过使用协议预先规避了相关风险(如下图),软件A的作者向平台方主张权利很难实现。

软件开发人员在开发过程中应该要提高风险合规意识,对于“一切非本人所编写代码”进行更加严格的审查,包括功能、安全、知识产权等。

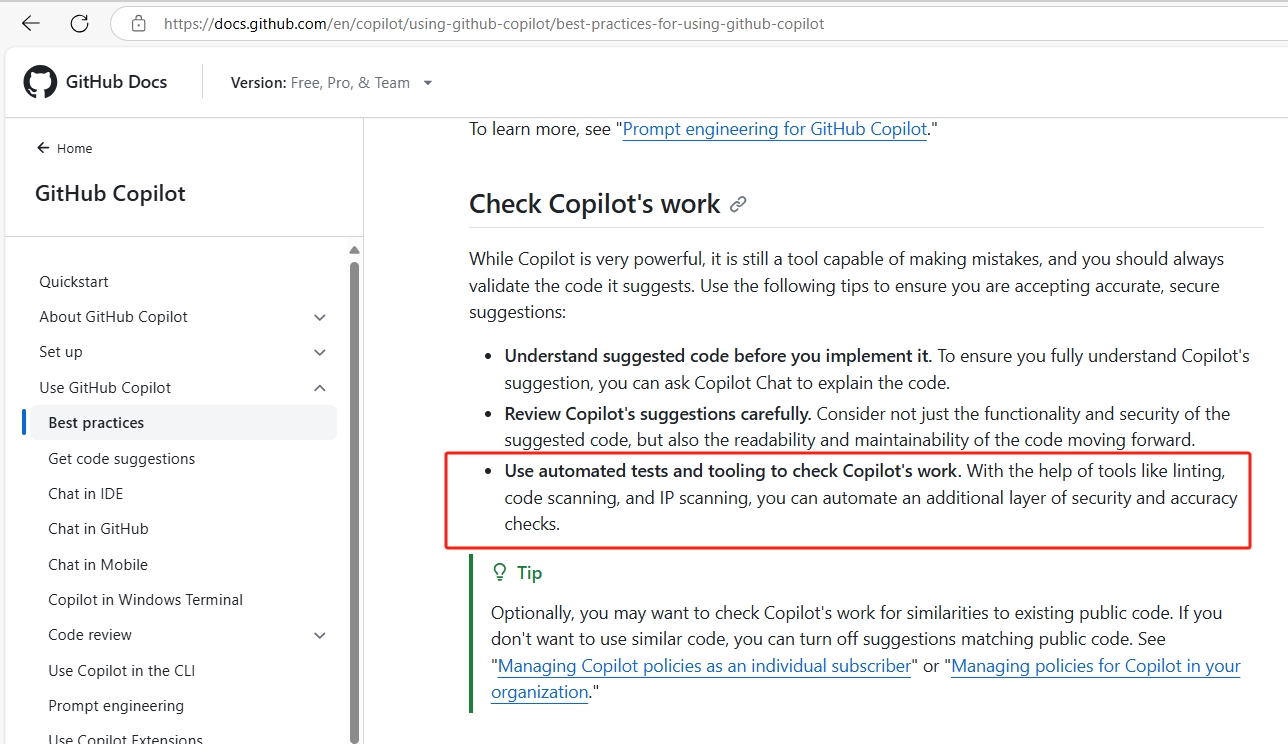

虽然Copilot非常强大,但它仍然是一种可能犯错的工具,你应该始终验证它建议的代码。使用以下提示确保你接受的是准确、安全的代码建议:

在实现建议的代码之前先理解它。为了确保你完全理解Copilot的建议,你可以要求Copilot Chat解释代码。

仔细审查Copilot的建议。考虑的不仅仅是建议代码的功能和安全性,还有代码的可读性和未来的可维护性。

使用自动化测试和工具来检查Copilot的工作。借助像代码检查、代码扫描和知识产权扫描这样的工具,你可以自动化额外的安全和准确性检查层。

图片内容的机器翻译

源小印认为虽然平台方采取这种规避风险的方式是常见的、合法的,开发者也理应履行注意义务。在具体纠纷中我们仍应考虑平台方的义务问题,尤其涉及到“付费用户”时。

抛开AI训练过程中对公共领域知识利用的众多法律争议不谈,当软件A的作者是平台的付费用户时,平台方输出代码时就已经属于到将相关作品用于商业目的,远超“个人学习”、“非商业目的”的范畴,理应履行更高的注意和提示义务。因此,平台方向付费用户输出的代码,理应列举出代码的来源,以便于用户进行必要审查。如果因为平台方未列举来源,或者列举的来源不正确,则平台方理应承担责任。

这样的处理方式既不会限制AI人工智能在编程方面的应用,又不至于平台方信马由缰、野蛮生长,能够有效把握科技发展与责任承担之间的平衡点。

《编程神器 Copilot 逐字抄袭他人代码?GitHub 回应:相似,但不同...... 》来源: 知乎

《AI辅助编程有可能盗用开源软件代码吗?》来源: 知乎

《人工智能生成内容著作权规制的全球趋向与本土路径》 来源:知识产权杂志

《涉“开源软件”著作权侵权案件中权利基础的认定》最高人民法院知识产权法庭公众号

引用来源

本站文章除裁判文书外均为原创作品,版权归长沙源小印科技有限公司所有,未经许可,不得转载!